Evan Leonardo Flores Pérez[2o Cozumel], Alek Dan Salazar Valdés[2o Cozumel], Jose Nicolas Reyes Reyes[2o Cozumel]

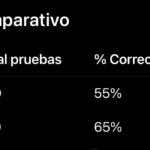

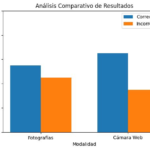

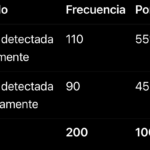

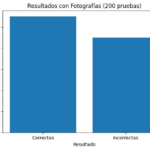

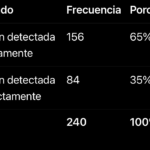

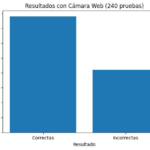

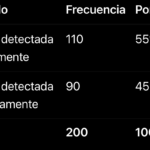

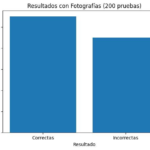

El presente proyecto tuvo como finalidad entrenar una inteligencia artificial utilizando la plataforma Teachable Machine, con el objetivo de que lograra reconocer emociones humanas a través del análisis del rostro. La investigación se centró en comprobar qué tan precisa puede ser una herramienta de aprendizaje automático al interpretar gestos faciales relacionados con emociones básicas. Para el desarrollo del proyecto se entrenó al modelo con distintas imágenes que representan emociones como alegría, tristeza, etc. Posteriormente, se realizaron pruebas en dos modalidades: 200 pruebas mediante fotografías previamente cargadas y 240 pruebas utilizando la cámara web en tiempo real. Los resultados mostraron que en las imágenes estáticas el sistema logró un 55% de aciertos, mientras que en tiempo real obtuvo un 65% de respuestas correctas. Aunque los resultados demuestran que la IA puede reconocer ciertos patrones faciales, también evidencian que la interpretación de emociones humanas es un proceso complejo. Factores como la iluminación, el ángulo del rostro, la intensidad del gesto y las diferencias individuales influyen directamente en la precisión del modelo. Este proyecto comprende que el reconocimiento emocional mediante IA requiere mayor entrenamiento, más datos y un análisis más profundo. Asimismo, deja abierta la posibilidad de continuar investigando para mejorar la capacidad de los sistemas tecnológicos de comprender la complejidad de las emociones, sin embargo también es importante que la tecnología pueda ayudar pero no reemplazar al ser humano y su capacidad de reconocer emociones incluso aunque estas sean fingidas, y por mucho avance la tecnología no puede reemplazar la complejidad del cerebro humano.

The aim of this project was to train an artificial intelligence using the Teachable Machine platform to recognize human emotions through facial analysis. The research focused on determining the necessity of a machine learning tool for interpreting facial gestures related to basic emotions. The model was trained using various images representing emotions such as joy and sadness. Subsequently, tests were conducted in two modalities: 200 tests using pre-loaded photographs and 240 tests using a webcam in real time. The results showed that the system achieved a 55% accuracy rate with static images, while in real time it obtained 65% correct responses. Although the results demonstrate that AI can recognize certain facial patterns, they also highlight the complexity of interpreting human emotions. Factors such as lighting, facial angle, gesture intensity, and individual differences directly influence the model’s accuracy. This project concludes that emotional recognition using AI requires more training, more data, and more in-depth analysis. It also leaves open the possibility of continuing research to improve the ability of technological systems to understand the complexity of emotions; however, it is also important to remember that technology can help but not replace human beings and their ability to recognize emotions, even if they are feigned, and no matter how much technology advances, it cannot replace the complexity of the human brain.

Nopa tekitl kinekiyaya kinmachtis se modelo tlen inteligencia artificial tlen kitekiuia nopa plataforma Teachable Machine pampa kiixmatis tlen kiyolmatij maseualmej ika se tlatemolistli tlen ixko. Kimachtijkej ika tlaixkopinkayomej tlen pakilistli, tlaijiyouilistli uan kualantli. Ome ciento tlayejyekoli mochijkej ika tlaixkopinkayomej uan 240 ipan tonali tlen melauak. Nopa sistema kipixki 55% tlen melauak ika tlaixkopinkayomej tlen amo mojmoliníaj uan 65% ika tlaixkopinkayomej tlen webcam. Tlamantli kej tlauili, angulo uan chikaualistli kipaleuik nopa tlayejyekoli. Nopa tlamachtili ki ijtoa nopa AI moneki más datos uan tlamachtili para kuali tekitis.

En este apartado se debe dar presentación al tema de investigación, problema, los objetivos, justificación, posible solución (hipótesis o meta de ingeniería) y objetivos de desarrollo sostenible que abona la investigación, describe el estudio.

Explica el tema. ¿Qué aspectos respecto de ese tema se está investigando? Los objetivos del trabajo (Inv.) La metodología. ¿Cuál es la forma y en qué condiciones se realiza? ¿A quiénes se beneficia con el avance de lo logrado? ¿En qué nivel se logró la intención inicial del proyecto?

Comience presentando ampliamente el tema, luego proporcione información general de fondo, restringiéndose a la investigación de fondo específica y, finalmente, una pregunta de investigación enfocada, una hipótesis o una declaración de tesis (de lo general a lo específico).

En este tema la importancia recae en la innovación tecnológica, ya que aunque la tecnología sea capaz de reconocer rostros y rasgos biométricos, aún no hay tanto desarrollo en expresiones faciales para lograr reconocer las emociones, lo cual podría ser un gran avance en la tecnología moderna con herramientas fáciles de usar. Este proyecto busca integrar fotografías a una IA para reconocer emociones a través de expresiones faciales utilizando la herramienta tecnológica Google Teachable Machine siendo una página de fácil acceso, de simple manejo y amigable con el usuario. Se recolectan más de 300 fotografías aproximadamente integrales a la IA con el propósito de entrenarla y de esta manera lograr evaluar su funcionamiento en el reconocimiento de emociones por medio de una cámara web integrada en una computadora y/o teléfono celular donde los rostros de las personas son comparados con los de las fotografías de la IA y de esta manera reconoce la emoción de la persona.

Las emociones humanas son complejas y muchas veces están combinadas, lo cual complica el reconocimiento facial en las inteligencias artificiales. En este tema el mayor problema recae en la innovación tecnológica, ya que aunque la tecnología ya sea capaz de reconocer rostros y rasgos biométricos, aún no hay tanto desarrollo en expresiones faciales para lograr reconocer las emociones, lo cual podría ser un gran avance en la tecnología moderna con herramientas fáciles de usar. Se pretende dar un avance en el reconocimiento de emociones, y de esta forma progresar tecnológicamente con máquinas que puedan detectar las emociones y dar distintos datos según el estado de ánimo, algo de lo que todavía no existen antecedentes. Para varias inteligencias artificiales es un rasgo que aún no se estudia completamente y puede lograr ser más específico el reconocimiento debido a que dividirá las emociones en distintos porcentajes. También uno de los retos a resolver es la cantidad de imágenes requeridas para un reconocimiento eficaz.

Si logramos integrar fotografías a una IA, entonces permitirá reconocer emociones a través de expresiones faciales en las personas.

Evaluar el funcionamiento de una IA en el reconocimiento de emociones integrando fotografías de expresiones faciales.

Integrar fotografías a una IA para reconocer emociones a través del reconocimiento de expresiones faciales.

Industria, innovación e infraestructura. Construir infraestructuras resilientes ,promover la industrialización sostenible y la innovación.

Las emociones, esas fuerzas invisibles que rigen nuestras vidas, han cautivado la mente humana desde tiempos inmemoriales. Desde la antigüedad hasta nuestros días, filósofos, teólogos, médicos y artistas han intentado desentrañar sus misterios, buscando comprender su origen, su naturaleza y su influencia en nuestro comportamiento.

La historia de las emociones está íntimamente ligada a la historia del pensamiento humano. En la antigüedad, las emociones se entendían como fuerzas poderosas, a menudo divinas, que podían llevar al individuo a la grandeza o a la ruina. Los griegos, por ejemplo, creían que las emociones eran impulsadas por los humores, fluidos corporales que podrían desequilibrarse y causar enfermedades mentales.

En la Edad Media, la influencia de la religión cristiana marcó la forma de entender las emociones. Se consideraban como pecados, especialmente las pasiones como la ira, la lujuria y la avaricia. La Iglesia Católica, a través de la confesión y la penitencia, buscaba controlar y purificar las emociones humanas.

El siglo XIX fue un período crucial para el desarrollo de la psicología moderna. Charles Darwin, en su obra “La expresión de las emociones en el hombre y los animales”, demostró que las emociones tenían un origen evolutivo y que eran universales en todas las culturas.

El desarrollo de las emociones en la infancia: un viaje maravilloso.

El desarrollo emocional de los niños es un proceso complejo y maravilloso que ha sido objeto de estudio por parte de los psicólogos desarrollistas durante décadas. Los primeros años de vida son cruciales para el desarrollo de las emociones, ya que es en este período cuando el cerebro se está formando y creando conexiones neuronales que permitirán al niño entender y regular sus emociones.

Los niños, desde su nacimiento, muestran una gama limitada de emociones básicas, como la aflicción y el disgusto. A medida que el niño crece, su repertorio emocional se expande, incluyendo emociones como la alegría, la tristeza, el miedo y la sorpresa. Este desarrollo no ocurre de forma lineal, sino que sigue un patrón específico, con algunas emociones apareciendo antes que otras.

Influencias ambientales: cómo el entorno moldea nuestras emociones.

Aunque el desarrollo emocional está fuertemente influenciado por factores biológicos, el entorno también juega un papel crucial. Niños maltratados, por ejemplo, pueden mostrar miedo y tristeza a edades más tempranas de lo que se consideraba normal. Esto sugiere que las experiencias tempranas, especialmente las negativas, pueden afectar profundamente el desarrollo emocional del niño.

Otro factor importante es la capacidad cognitiva. Los niños más pequeños, al no tener una imagen mental de cómo debería ser algo, no muestran las mismas reacciones emocionales que los niños mayores. Por ejemplo, un niño de un mes puede mostrar interés ante un rostro distorsionado, mientras que un niño de siete meses puede reaccionar con miedo y disgusto. Esto se debe a que el niño mayor ya tiene una imagen mental de cómo debería ser un rostro, y la diferencia le produce una respuesta emocional negativa.

En la adolescencia, el desarrollo emocional alcanza su punto culminante con el avance cognitivo que Jean Piaget llamó operación formal. Esta capacidad permite a los adolescentes analizar la lógica de las creencias y cuestionar el entorno que les rodea. Esto lleva a la aparición de emociones más abstractas y complejas, como la frustración, la decepción y la angustia.

Las emociones en la cultura: una mirada a la diversidad humana.

Las emociones son universales, pero la forma en que las expresamos y las experimentamos varía de una cultura a otra. Algunas culturas, por ejemplo, valoran la expresión abierta de las emociones, mientras que otras prefieren la contención.

La historia también juega un papel importante en la forma en que las emociones se expresan y se interpretan. En la antigüedad, por ejemplo, la tristeza se consideraba una emoción noble y digna, mientras que en la Edad Media se veía como un signo de debilidad. La cultura también influye en la forma en que entendemos y damos sentido a nuestras emociones. En algunas culturas, la ira se considera una emoción negativa que debe ser controlada.

El futuro de las emociones: hacia una comprensión más profunda.

El estudio de las emociones es un campo en constante evolución. Los avances en neurociencia y psicología están revelando nuevos conocimientos sobre la naturaleza de las emociones y su influencia en nuestro comportamiento.

El futuro de las emociones se centra en una comprensión más profunda de cómo las emociones funcionan a nivel biológico, cómo se desarrollan en la infancia y cómo se expresan en diferentes culturas. También se está investigando el papel de las emociones en la salud mental, el bienestar y la toma de decisiones.

¿Cuáles son las emociones básicas?

Las emociones básicas son aquellas que se consideran universales y que están presentes en todas las culturas. Entre las emociones básicas se encuentran la alegría, la tristeza, la ira, la sorpresa y el disgusto.

¿Cómo se ha estudiado la emoción a lo largo de la historia?

La emoción ha sido estudiada desde la antigüedad, pero el enfoque ha cambiado a lo largo del tiempo. En la antigüedad, la emoción se entendía como una fuerza divina o como un fluido corporal. En el Renacimiento, se estudió la expresión facial de la emoción. En el siglo XIX, se desarrolló la psicología moderna, que estudió la emoción como un proceso mental y fisiológico.

¿Cuáles son los últimos avances en la investigación de la emoción?

Los últimos avances en la investigación de la emoción se centran en la neurociencia y la psicología. Los investigadores están utilizando técnicas como la resonancia magnética funcional para estudiar cómo el cerebro procesa la emoción. También están investigando el papel de la emoción en la salud mental, el bienestar y la toma de decisiones.

¿Qué es una imagen generada por IA?

El concepto de inteligencia artificial proporciona información suficiente para entender lo que representa una imagen generada por IA.

Una imagen generada por IA es una imagen creada con la ayuda de inteligencia artificial, a menudo impulsada por IA Generativa que se especializa en producir contenidos nuevos y originales, como textos, imágenes o incluso música.

La primera imagen de la historia generada por inteligencia artificial

¿Cuál fue la primera imagen generada por IA? La primera imagen generada por IA fue creada por un sistema de IA llamado AARON.

Este sistema fue creado por un artista y programador, Harold Cohen.

La primera imagen generada por IA no era tan fácil como la que tenemos ahora. El profesor Cohen tardó décadas en entrenar su sistema de IA para dibujar y pintar a su estilo.

Pero su creación fue la prueba de que los ordenadores no sólo podían calcular, sino que también eran capaces de crear arte realista.

Harold Cohen dotó a AARON de conocimientos básicos de física y dibujo.

Los inicios del arte de la IA se remontan a la década de 1960:

Georg Nees fue uno de los principales innovadores del arte de la IA, el arte digital y el arte generativo.

Creó los primeros gráficos por ordenador en Alemania.

Algunos se refieren a Nees como un genio académico que encontró su camino hacia el arte informático a través de las matemáticas, la física y la filosofía.

Georg trabajaba en Siemens y se le encargó encontrar la forma de hacer útil la máquina de la empresa, la Zuse Graphomat Z64.

Durante su experimentación con el Z64, descubrió una forma de crear gráficos con la máquina.

En 1965, se convirtió en el primer infografista generativo en mostrar su trabajo en una exposición en el Stuttgart College.

Como Georg Nees, Frederick también fue uno de los pioneros del arte digital y generativo.

En 1963 realizó su primera obra.

Realizaba imágenes abstractas utilizando un ordenador, una máquina de cinta y una máquina de dibujo.

En 1999 creó el Proyecto CompArt: un espacio para el arte informático. Después se convirtió en teórico, escritor, creador y profesor de arte digital.

Nake, Nees y A. Michael Noll fueron descritos como las 3N de los gráficos digitales.

Noll es conocido como uno de los primeros tecnólogos en dedicarse al arte por ordenador, el arte digital y la animación en 3D.

En 1961, Michael Noll comenzó su andadura en los laboratorios Bells de Nueva Jersey.

En Bells Labs, se interesó por el arte informático cuando el trazador de su colega creó un error que le pareció interesante.

Debido a ello, comenzó a explorar patrones de sistemas similares con pseudoaleatoriedad.

Curiosamente, Noll decidió no clasificar su obra como arte porque no quería tener problemas con el mundo artístico tradicional.

A pesar de su negativa a clasificar, sus obras se han expuesto en todo el mundo. Fue el primer artista informático de Estados Unidos que expuso en la Howard Wise Gallery.

Originalmente, Harold Cohen comenzó a explorar la posibilidad de utilizar programas informáticos para la creación de arte en la década de 1960.

Su interés por el arte informático se debía a su deseo de “entender qué es el arte”. También podría decirse que le interesaba encontrar una forma de crear arte después de su muerte.

Cuando Cohen creó AARON, sólo podía producir dibujos lineales monocromos que Cohen tenía que colorear a mano.

Pero en los años 80, Harold introdujo modificaciones que permitieron a AARON elegir y aplicar los colores por sí mismo.

A continuación, el programa fue capaz de producir formas del mundo real, como follaje y figuras humanas.

Tras actualizar AARON, Harold Cohen pudo exponerlo en importantes instituciones de arte y tecnología, como la Tate Modern y el Whitney Museum of American Art.

La tecnología que está detrás de la creación del primer arte de inteligencia artificial es AARON.

Cuando Cohen desarrolló AARON, la herramienta no utilizaba aprendizaje profundo ni redes neuronales como las que tenemos hoy en día.

En su lugar, funcionaba con reglas y algoritmos que Harold tardaba tiempo y esfuerzo en codificar. Dio instrucciones a AARON sobre cómo dibujar e imitar el proceso creativo de un artista.

Cohen enseñó a la herramienta a dibujar líneas, a enlazar líneas con formas y figuras, a dibujar curvas y a producir resultados que parecían más originales y realistas que el arte generado por ordenador en los años sesenta.

Así que se puede decir que se centraba más en la lógica subyacente del dibujo.

Los esfuerzos de Cohen son como enseñar a un robot a dibujar dándole instrucciones explícitas en lugar de mostrarle miles de ejemplos para que los imite.

El planteamiento que utilizó AARON es muy diferente del que tenemos ahora, pero el hecho de que sentará las bases no puede discutirse.

Así funcionaba AARON:

El inconveniente del planteamiento de Cohen era que tenía que predecir todas las situaciones posibles y codificarlas.

Puede imaginarse cuánto trabajo y tiempo empleó Cohen antes de que su herramienta pudiera dibujar una sola imagen.

La generación de imágenes mediante inteligencia artificial se ha desarrollado a partir de los dibujos en blanco y negro realizados por AARON.

Las obras de arte básicas se han vuelto hiperrealistas y casi no se distinguen de las creaciones humanas.

He aquí cómo ha evolucionado la generación de imágenes con inteligencia artificial desde la primera imagen:

Primero llegó el arte de la programación basada en reglas y luego el arte de la IA basada en el aprendizaje automático.

A diferencia de la era AARON, la inteligencia artificial de generación de imágenes en la máquina utiliza el aprendizaje profundo y las redes neuronales para crear arte.

Así, en lugar de basarse en reglas, las imágenes de IA se crearon estudiando y analizando imágenes reales y generación de nuevas imágenes basado en los patrones y el estilo artístico aprendidos.

La introducción de las redes generativas adversariales (GAN) ha permitido generar imágenes de IA.

Las GAN funcionan con dos redes neuronales, una que genera la obra de arte y otra que la evalúa.

Estas dos redes trabajan juntas para crear imágenes visualmente atractivas y demostrar una comprensión de las reglas y técnicas artísticas.

En 2021, se creó otro sistema de IA.Este sistema marcó un punto de inflexión en la IA generativa. DALL-E fue anunciado por OpenAI y se describió como un sistema capaz de generar imágenes a partir de un texto.

El sistema DALL-E era capaz de producir imágenes realistas en diferentes estilos, y también podía combinar conceptos divertidos y darles vida.

Se construyó modificando GPT. El sistema DALL-E tuvo éxito gracias a la cantidad de datos de entrenamiento que OpenAI introdujo en él.

En junio de 2023, OpenAI anunció un sistema nuevo y mejorado llamado DALL-E 2. Utiliza un algoritmo más potente llamado modelos de difusión.

DALL-E 2 fue capaz de eliminar el ruido que se había añadido a una imagen. Los sistemas modernos también han avanzado de la creación a la recuperación, dónde búsqueda visual con IA permiten a los usuarios encontrar imágenes concretas en vastas bases de datos mediante el reconocimiento de contenidos.

En resumen, la evolución de la Generación de Imágenes AI trajo consigo lo siguiente:

¿Aplicación utilizada?

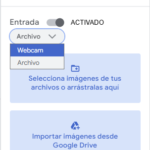

La aplicación usada es “Google Teachable Machine”. Teachable Machine es una herramienta basada en la Web que hace posible crear modelos de aprendizaje automático de manera rápida, sencilla y accesible para todos.

¿Cómo funciona?

Ve a teachablemachine.withgoogle.com y haz clic en ‘Primeros pasos’. No tienes que crear una cuenta ni iniciar sesión.

Vivimos en una era tecnológicamente avanzada.

Aunque los avances no han alcanzado el nivel de la lectura de la mente, existen alternativas que la asemejan y una de ellas son las imágenes generadas por IA.

Con la inteligencia artificial, es fácil generar imágenes de alta calidad con sólo describir lo que tienes en mente al asistente de IA que elijas.

Los generadores de imágenes con IA se han vuelto más populares de lo que cabría esperar, y diversas organizaciones están empezando a adoptar esta tecnología. Por ejemplo, aplicaciones de redes sociales como Instagram, Snapchat o ImagineArt tienen incorporadas Generador de imagnes AI, funciones a través de indicaciones que te ayudan a crear imágenes con IA. Las principales plataformas están integrando capacidades de generación de imágenes con IA directamente en sus flujos de trabajo, lo que hace que la creación de imágenes a partir de texto sea accesible para millones de usuarios.

Materiales:

Laptop o computadora con internet.

Celular para tomar fotografías.

Procedimiento:

Diseño de modelo que se utilizará en la plataforma “Google Teachable Machine”(https:teachable machine.with.google.com), la cual permite entrenar modelos de clasificación supervisada, en este caso: alegría, tristeza, enojo, miedo, sorpresa.

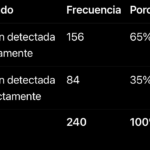

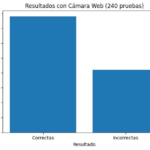

En las pruebas realizadas mediante fotografías previamente cargadas, el modelo logró una precisión del 55%, mientras que en el 45% de los casos la emoción fue clasificada de forma incorrecta. Esto indica una precisión moderada y posibles limitaciones en variaciones de iluminación, ángulos o calidad de imagen. En las pruebas realizadas en tiempo real con 15 sujetos a prueba mediante cámara web, se realizaron 240 intentos con estos sujetos, es decir con diferentes emociones. El modelo presentó una precisión mayor (65%). Esto sugiere que el sistema puede funcionar mejor cuando capta la expresión en movimiento y con ajustes automáticos de iluminación.

Los resultados obtenidos en este proyecto demuestran que la inteligencia artificial puede reconocer emociones a través del rostro, pero todavía no lo hace con total precisión. Aunque actualmente la tecnología tiene un alto nivel de exactitud en el reconocimiento facial al identificar personas, la predicción de emociones es más compleja. Las emociones humanas no dependen únicamente de un gesto, sino también del contexto, la intensidad de la expresión y las diferencias individuales entre personas. En este proyecto se observó que el sistema tuvo mejores resultados en tiempo real que con fotografías, pero aún presentó un margen importante de error. Esto demuestra que comprender emociones humanas es un reto mayor para la inteligencia artificial. Cabe destacar que aún existe el reto donde la tecnología puede ayudar, pero nunca reemplazar la comprensión humana.

Crawford, K. (2021). Atlas of AI: Power, politics, and the planetary costs of artificial intelligence. Yale University Press.

Ekman, P. (1992). An argument for basic emotions. Cognition & Emotion, 6(3–4), 169–200. https://www.tandfonline.com/doi/abs/10.1080/02699939208411068

Goodfellow, I., Bengio, Y., & Courville, A. (2016). Deep learning. MIT Press. https://www.deeplearningbook.org/

Google Creative Lab. (s.f.). Teachable Machine. https://teachablemachine.withgoogle.com

Russell, S., & Norvig, P. (2021). Artificial intelligence: A modern approach (4th ed.). Pearson.

https://basadoenhechosreales.com.ar/hechos-historicos-de-las-emociones/